Системы машинного обучения являются крайне полезными и распространёнными на сегодняшний день. И хоть мы с вами можем напрямую не осознавать то, как именно технологии машинного обучения влияют на нашу жизнь, на самом же деле они помогают нам чуть ли не везде. И теперь, для того чтобы ещё сильней улучшить данную сферу, команда, возглавляемая программистами из Массачусетского технологического института, изучила сразу десять наиболее цитируемых наборов данных, которые в свою очередь используются для того, чтобы проводить тестирование систем машинного обучения.

В результате многочисленных тестов было обнаружено, что около 3,4% всех данных на самом деле оказались неточными, либо же неправильно помеченными. И из-за этих процентов ошибок могло возникать большое количество проблем в системах искусственного интеллекта, использующих эти, самые популярные на данный момент в индустрии наборы данных. Каждый из таких наборов, к слову, является и в самом деле крайне популярным, часто используемым различными компаниями при создании собственных устройств. Каждый набор цитировался более 100,000 раз и включают в себя самые различные текстовые данные как из групп новостей, так и относящихся напрямую к таким компаниям, как Amazon и IMDb.

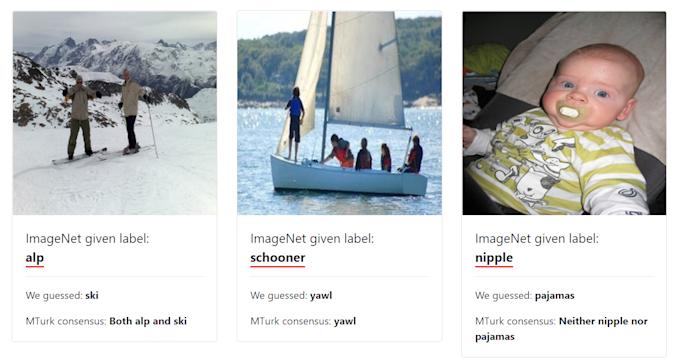

Уже выяснилось, что ошибки возникали из-за таких проблем, как отзывы о продуктах Amazon, которые, к примеру, неправильно маркировались как положительные, в то время как на самом деле они являлись отрицательными, и наоборот. Также некоторые из ошибок, которые в свою очередь основаны на изображениях, являются результатом «смешения различных видов животных». Другие ошибки возникли по причине неправильной маркировки фотографий с менее заметными объектами. Например, фотография отмечала именно бутылку с водой, которая прикреплена к велосипеду, а не сам велосипед. Более того, одна из ошибок и вовсе заключается в том, что набор данных машинного обучения по какой-то причине путает ребёнка с соском.

Не корректно данные наборы помечают также и аудио-визуальный контент. То есть, например, система считает, что одно из видео некого автора на YouTube, где он просто разговаривает со своими зрителями на камеру, помечается как видео, посвящённое «церковному колоколу». И да, вы, возможно, думаете, что эта информация вам не важна и она никаким образом вас не касается. Однако на самом же деле это не так, ведь именно из-за таких ошибок вы могли видеть, например, не корректные результаты поиска. Вы явно сталкивались с тем, что вы вбиваете где-либо один запрос, а среди его результатов появляется один или сразу несколько, которые никаким образом не связаны с тем что вы на самом деле ищите и запросили. Однако уже в ближайшем будущем все выявленные недочёты наборов машинного обучения будут устранены, и это очень хорошо.